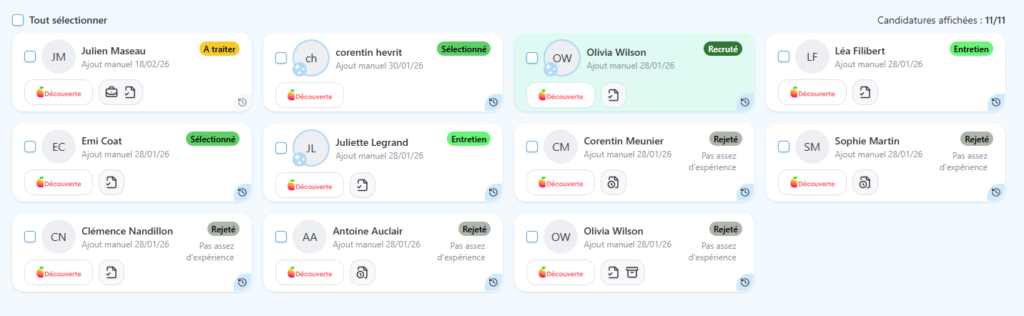

La inteligencia artificial se impone cada vez más en las prácticas de recursos humanos. Según un estudio de Gartner, más del 35 % de las empresas europeas ya utilizan herramientas que integran IA en sus procesos de reclutamiento. Clasificación automática de CV, evaluación de candidatos, matching de competencias, chatbots de RR. HH.… Los casos de uso se multiplican.

Pero esta automatización plantea una cuestión central para los reclutadores: ¿cómo conciliar la IA y el RGPD en el reclutamiento sin poner en riesgo los derechos de los candidatos ni el cumplimiento legal de la empresa? Hoy en día, todas las empresas utilizan un software de reclutamiento, por lo que todas cuentan con un ATS compatible con IA. ¡El reto es enorme! La protección de los datos de los candidatos es un aspecto sensible que debe protegerse.

IA Y RDPG: ¿Que dice la ley?

El uso de la inteligencia artificial en el reclutamiento no está prohibido. Sin embargo, está estrictamente regulado por el RGPD (Reglamento General de Protección de Datos) y por textos complementarios europeos. La protección de los datos es fundamental y está muy regulada para las empresas.

El principio básico es simple: todo dato personal tratado mediante una herramienta de IA debe respetar las normas de protección, transparencia y proporcionalidad. Cualquier empresa que no cumpla con esto puede enfrentarse a fuertes sanciones.

Los principios RDPG aplicables al reclutamiento

En un contexto de candidatura, los datos tratados pueden ser numerosos:

- CV

- Cartas de motivación

- Resultados de tests

- Datos de comportamiento

- Historiales de intercambios

- A veces, datos sensibles (de manera indirecta)

El RGPD impone varios principios clave:

Principio de finalidad: un uso estrictamente limitado al reclutamiento

El principio de finalidad establece que los datos de los candidatos deben recopilarse y utilizarse únicamente para un objetivo claramente definido, legítimo y explícito. En un contexto de reclutamiento con IA, esto significa que:

- Los datos se usan exclusivamente para la evaluación de las candidaturas.

- La información recopilada no puede reutilizarse para otros fines (marketing de RR. HH., prospección, formación interna…) sin una base legal distinta.

- Las finalidades deben documentarse en el registro de tratamientos.

👉 Ejemplo común de incumplimiento: usar los datos obtenidos de una herramienta de análisis de CV para alimentar otro sistema interno sin informar al candidato.

Principio de minimización: limitar los datos tratados por la IA

El RGPD exige recopilar únicamente los datos estrictamente necesarios para el proceso de reclutamiento.

Con la IA, existe el riesgo de multiplicar los puntos de análisis: datos de comportamiento, puntuaciones predictivas, metadatos, información obtenida de tests o cuestionarios automatizados.

Por lo tanto, los reclutadores deben hacerse una pregunta clave: ¿este dato es realmente útil para la decisión de reclutamiento?

Base legal del tratamiento: ¿interés legítimo o consentimiento?

Todo tratamiento de datos personales debe basarse en una base legal claramente identificada. En el reclutamiento, se utilizan principalmente dos bases:

- El interés legítimo de la empresa para evaluar candidaturas, siempre que no se vulneren los derechos y libertades de las personas.

- El consentimiento, especialmente cuando se implementan tratamientos específicos (tests automatizados, análisis de vídeo, scoring avanzado).

⚠️ Atención: el consentimiento debe ser libre, informado y específico. Simplemente enviar un CV no siempre es suficiente, sobre todo cuando la IA influye de manera significativa en la decisión.

Duración de conservación limitada: no almacenar los datos de forma indefinida

El principio de limitación de la duración de conservación se aplica con frecuencia de manera incorrecta en la práctica. Como regla general:

- Una candidatura no seleccionada no debe conservarse por más de 2 años,

- Salvo acuerdo explícito del candidato para una conservación más prolongada.

Con la IA, este punto es crítico, porque:

- Los datos pueden reutilizarse para entrenar modelos

- Los historiales a veces se conservan automáticamente por las herramientas.

Seguridad y confidencialidad de los datos personales

El RGPD obliga a las empresas a garantizar la seguridad y la confidencialidad de los datos. En un contexto de reclutamiento con IA, esto implica: un alojamiento seguro de los datos (preferiblemente en la UE), accesos limitados únicamente a las personas autorizadas, un cifrado de los datos sensibles, una trazabilidad de los accesos y de los tratamientos.

La responsabilidad no recae únicamente en el proveedor de la herramienta: el reclutador y la empresa siguen siendo responsables del tratamiento.

Principio de transparencia: informar claramente a los candidatos

La transparencia es un pilar central del RGPD en el reclutamiento. Los candidatos deben ser informados:

- De la existencia de un tratamiento automatizado.

- Del papel que juega la IA en el análisis de su candidatura.

- De los criterios generales utilizados.

- De sus derechos (acceso, rectificación, oposición, supresión).

Esta información debe ser: clara, accesible, comprensible y proporcionada desde el momento de la recopilación de los datos.

IA Act

La IA Act, es el reglamento europeo sobre inteligencia artificial que complementa al RGPD. Su objetivo es clasificar los sistemas de IA según su nivel de riesgo. Las herramientas de IA utilizadas en el reclutamiento, es decir, los ATS, están consideradas como sistemas de alto riesgo.

Esto implica para las empresas y los proveedores de software:

- Documentación completa del modelo.

- Trazabilidad de las decisiones.

- Supervisión humana obligatoria.

- Pruebas de sesgos y discriminación.

- Información clara para los usuarios.

Para los profesionales de RR. HH., esto significa una mayor responsabilidad

En la elección de la solución utilizada. Por lo tanto, es fundamental verificar que el software de reclutamiento cumpla con la legislación sobre tratamiento de datos.

¿Que dice la AEPD?

La Agencia Española de Protección de Datos (AEPD) es clara en este ámbito: el tratamiento de datos personales en los procesos de selección es especialmente sensible y debe gestionarse con las máximas garantías.

El organismo recuerda que:

- una decisión automatizada no puede ser completamente delegada a un sistema de IA

- el reclutador debe mantener un papel activo en el proceso

- el candidato debe ser informado del uso de inteligencia artificial

- debe existir la posibilidad de ejercer el derecho de oposición

Además, la AEPD insiste en la necesidad de un control humano efectivo, especialmente cuando la IA influye de forma significativa en la selección o descarte de candidaturas. La toma de decisiones debe permanecer en manos del reclutador y no puede delegarse íntegramente en sistemas automatizados.

Más allá del riesgo de posibles discriminaciones, una dependencia excesiva de la IA puede incluso impedir que la empresa identifique al mejor candidato.

¿Nuevas leyes próximamente en marcha?

Sí, y es un punto clave para los directores y responsables de RR. HH. Además del RGPD y del IA Act, varios textos están en discusión o en proceso de aplicación:

- Normas europeas sobre la transparencia algorítmica.

- Obligaciones reforzadas sobre la justificación de las decisiones tomadas por el reclutador.

- La regulación de los modelos predictivos en RR. HH.

El objetivo es claro: evitar los riesgos asociados a sistemas de IA que puedan generar decisiones discriminatorias o injustificables. Por lo tanto, las empresas deben anticipar estas evoluciones desde ahora, especialmente en sus procesos de reclutamiento.

Los departamentos de RR. HH. deben mantener un papel decisivo y, sobre todo, una actitud crítica frente a la IA. De hecho, actualmente se distinguen dos tipos de perfiles: quienes ya confían en la IA en el reclutamiento y quienes no la utilizan en absoluto por miedo a sus posibles efectos negativos.

¿Qué riesgos asumen los departamentos de RR. HH. en caso de incumplimiento de la normativa?

El incumplimiento del RGPD y de las normativas relacionadas con el uso de la inteligencia artificial en los procesos de selección expone a las empresas a diversos riesgos importantes. Podemos destacar, principalmente, los siguientes:

Riesgos legales

Directamente relacionados con la legislación vigente, las empresas que no cumplen con estas normativas pueden enfrentarse a distintas sanciones:

- Sanciones económicas: pueden alcanzar hasta 20 millones de euros o el 4 % de la facturación anual global, tal y como establece el RGPD.

- Requerimientos o sanciones por parte de la AEPD

- Conflictos legales con candidatos: por un uso indebido de sus datos personales o por decisiones automatizadas que puedan derivar en casos de discriminación, lo que puede conllevar procedimientos judiciales y daños reputacionales.

Riesgos humanos

Se trata de riesgos directamente relacionados con los candidatos y con el propio proceso de selección:

- Pérdida de confianza de los candidatos: una mala gestión de los datos o del uso de la IA puede generar desconfianza y rechazo hacia la empresa.

- Impacto negativo en la marca empleadora: la empresa pierde atractivo y puede ser percibida como una organización que no respeta a los candidatos.

- Sensación de injusticia o discriminación: decisiones tomadas únicamente por sistemas de IA pueden generar percepciones de falta de equidad, e incluso provocar rechazo hacia la empresa o crisis reputacionales vinculadas al uso de datos personales.

Riesgos organizativos

Son aquellos riesgos que afectan directamente al funcionamiento interno de la empresa:

- Bloqueo o limitación de herramientas: el uso indebido de tecnologías puede llevar a restricciones o prohibiciones en su utilización.

- Necesidad de rediseñar el sistema de reclutamiento: la empresa puede verse obligada a revisar por completo sus procesos para cumplir con la normativa.

- Pérdida de rendimiento en RR. HH.: menor calidad de candidaturas, procesos menos eficientes y aumento de los costes de reclutamiento.

Desventajas de la inteligencia artificial en el reclutamiento

Riesgo de sesgos algorítmicos y discriminación

La inteligencia artificial se basa en datos históricos para aprender y generar resultados. Si estos datos están sesgados, incompletos o no son representativos, el modelo de IA reproducirá automáticamente esos sesgos.

En el ámbito del reclutamiento, esto puede dar lugar a discriminaciones indirectas, por ejemplo, desfavoreciendo determinados perfiles, formaciones, edades o trayectorias no convencionales. A diferencia de un reclutador humano, un algoritmo aplica sus criterios a gran escala, lo que amplifica los efectos negativos en caso de error.

Este riesgo es especialmente crítico desde el punto de vista legal, ya que cualquier decisión discriminatoria puede exponer a la empresa a sanciones jurídicas y a un deterioro de su marca empleadora.

Falta de transparencia en las decisiones de la IA

Muchos softwares de reclutamiento basados en IA funcionan como auténticas “cajas negras”. En muchos casos, el reclutador no sabe con exactitud qué criterios utiliza el algoritmo para analizar candidaturas o asignar puntuaciones.

Sin embargo, el RGPD exige transparencia y la capacidad de explicar, al menos a grandes rasgos, cómo funcionan los tratamientos automatizados. En caso de reclamación, la empresa debe poder justificar sus decisiones.

La falta de explicabilidad no solo compromete el cumplimiento normativo, sino que también dificulta la gestión de los derechos de los candidatos.

Dependencia excesiva de la herramienta frente al criterio humano

Uno de los principales riesgos del uso de la IA en reclutamiento es la tendencia a delegar completamente la toma de decisiones en la tecnología.

Apoyarse en exceso en puntuaciones o recomendaciones automatizadas puede hacer que el reclutador pierda su capacidad crítica y su rol como evaluador. Sin embargo, el proceso de selección implica un análisis global del candidato: motivación, potencial o encaje cultural, aspectos difíciles de medir únicamente con IA.

Además, el marco normativo europeo y organismos como la AEPD recuerdan que las decisiones con impacto significativo no deben estar totalmente automatizadas, sino contar con supervisión humana.

Posible deshumanización de la experiencia del candidato

Un uso excesivo de la automatización puede deteriorar la experiencia del candidato. Respuestas genéricas, falta de interacción o ausencia de feedback personalizado pueden generar frustración y sensación de exclusión.

En un mercado laboral competitivo como el español, esta deshumanización impacta directamente en la percepción de la empresa. La IA debe entenderse como una herramienta al servicio de las personas, no como un sustituto del trato humano. Un uso inadecuado puede dañar la relación con los candidatos y reducir la capacidad de atracción de talento.

Riesgos en la protección de datos personales

El uso de inteligencia artificial implica, en muchos casos, el tratamiento de grandes volúmenes de datos personales, algunos de ellos sensibles o indirectamente identificables.

Cuanto más complejo es el sistema, mayores son los riesgos de fallos de seguridad, configuraciones incorrectas o incumplimiento de los plazos de conservación de datos.

En caso de infracción, la responsabilidad recae directamente sobre la empresa, incluso cuando la herramienta es proporcionada por un proveedor externo. Por ello, la gestión de los flujos de datos, los accesos y el almacenamiento se convierte en un aspecto crítico para cualquier organización que utilice IA en sus procesos de selección.

Buenas prácticas para reclutar con IA de forma ética

Reclutar con inteligencia artificial no es un problema en sí mismo. Es natural que las empresas evolucionen y adapten sus procesos de selección a nuevas tecnologías. La clave está en cómo se utiliza. A continuación, algunas buenas prácticas:

1.Elegir un ATS conforme con la normativa europea

Es fundamental seleccionar herramientas que cumplan con el RGPD y la normativa europea en materia de protección de datos.

Muchas empresas confían en proveedores que no garantizan dónde se alojan los datos o cómo se gestionan, lo que puede generar riesgos legales y de confianza. Por ello, es recomendable optar por soluciones que:

- Garanticen el alojamiento de datos en la Unión Europea

- Cumplan con los estándares europeos de seguridad

- Ofrezcan transparencia sobre el uso de la inteligencia artificial

La soberanía de los datos y su correcta gestión son elementos clave tanto para el cumplimiento legal como para generar confianza en los candidatos.

2.Transparencia en el uso de los datos: informar a los candidatos

Los candidatos deben estar informados de manera clara sobre:

- La existencia de tratamientos automatizados

- El papel de la inteligencia artificial en el análisis de su candidatura

- Las principales lógicas utilizadas

- Sus derechos (acceso, rectificación, oposición y supresión)

Esta información debe ser clara, accesible y comprensible desde el primer momento.

Un candidato que descubre posteriormente que una IA ha influido en la decisión puede cuestionar el proceso. Por eso, la transparencia desde el inicio es esencial.

3.Mantener el control humano

El control humano es un requisito clave del RGPD en cualquier proceso de reclutamiento que utilice IA.

Una decisión con impacto significativo, como descartar a un candidato, no puede basarse únicamente en un tratamiento automatizado. La IA debe utilizarse como una herramienta de apoyo, nunca como un decisor autónomo.

En la práctica, esto implica que el reclutador debe:

- Comprender los criterios utilizados por el sistema

- Analizar los resultados con espíritu crítico

- Poder ajustar o cuestionar las recomendaciones del algoritmo

- Asumir la decisión final

Además, este control debe ser documentado y trazable, especialmente ante posibles revisiones por parte de la Agencia Española de Protección de Datos o en caso de conflictos legales.

Combinar tecnología con criterio humano permite garantizar el cumplimiento normativo y mejorar la calidad del proceso de selección.

4.Formar a los reclutadores en el uso responsable de la IA

La formación es esencial para garantizar un uso ético de la inteligencia artificial en recursos humanos.

Un sistema de IA, por avanzado que sea, no sustituye la experiencia ni el juicio profesional. Los equipos de RR. HH. deben comprender:

- Cómo funciona el sistema de IA

- Qué datos personales se procesan

- Cuáles son sus limitaciones

- Qué riesgos existen (sesgos, automatización excesiva, etc.)

Esta capacitación permite evitar una dependencia excesiva de la tecnología y mantener la calidad en la toma de decisiones.

Además, formar a los equipos también implica sensibilizarlos sobre protección de datos, transparencia y cumplimiento legal. Invertir en formación refuerza tanto la seguridad del proceso como su dimensión humana.

¿Las ventajas de usar un software de reclutamiento con IA ética?

El uso de herramientas de reclutamiento con inteligencia artificial, cuando se implementa de forma responsable, ofrece múltiples beneficios:

- Permite ahorrar tiempo al automatizar el filtrado de candidaturas sin eliminar el control humano

- Estructura el proceso de selección mediante criterios homogéneos para todos los candidatos

- Refuerza el cumplimiento del RGPD gracias a la trazabilidad de los datos y decisiones

- Reduce ciertos sesgos humanos al basarse en criterios objetivos definidos previamente

- Mejora la experiencia del candidato con respuestas más rápidas y comunicación más fluida

- Aumenta la seguridad jurídica frente a las exigencias de la Agencia Española de Protección de Datos y el marco europeo, incluido el Reglamento de IA (AI Act)

- Facilita el ejercicio de los derechos de los candidatos mediante sistemas centralizados

- Permite una gestión de RR. HH. basada en datos, con indicadores fiables para la toma de decisiones

- Garantiza un equilibrio entre eficiencia tecnológica y responsabilidad humana en el reclutamiento